1) 보이스클로닝의 정의: 정확히 무엇인가?

보이스클로닝(Voice Cloning) 은 특정 화자의 음성 특징, 음색(timbre), 억양(intonation), 말투(speaking style), 화자 정체성(speaker identity)을 AI 모델이 학습하여, 해당 화자가 직접 말하지 않은 새로운 문장을 그 사람의 목소리로 합성하는 기술입니다.

쉽게 말하면:

"내 목소리를 AI에 학습시키면, AI가 내 목소리로 어떤 문장이든 읽어주는 기술"

일반적인 TTS(Text-to-Speech)가 "미리 준비된 AI 음성으로 텍스트를 읽는 기술" 이라면, 보이스클로닝은 "특정 사람의 목소리를 복제해서 새로운 음성을 만드는 기술" 입니다.

보이스클로닝 vs TTS vs 음성 변환(Voice Conversion)

| 기술 | 입력 | 출력 | 핵심 |

|---|---|---|---|

| TTS | 텍스트 | 미리 학습된 AI 음성 | 텍스트를 소리로 변환 |

| 보이스클로닝 | 텍스트 + 화자 음성 샘플 | 특정 화자의 목소리 | 화자 정체성을 유지한 합성 |

| 음성 변환 | 음성 A | 화자 B의 음색으로 변환 | 실시간 음색 변환 |

보이스클로닝은 이 중에서 "누가 말하고 있는가"가 중요한 모든 서비스에서 가치를 가집니다.

2) 보이스클로닝의 종류: Zero-shot vs Few-shot vs Fine-tuning

보이스클로닝은 필요한 음성 데이터 양에 따라 크게 3가지로 나뉩니다.

Zero-shot 보이스클로닝

- 필요 음성: 2~10초

- 학습 과정: 없음 (추론 시점에 즉시 적용)

- 특징: 가장 빠르고 편리. 별도 학습 없이 짧은 기준 음성만으로 화자 특성을 반영

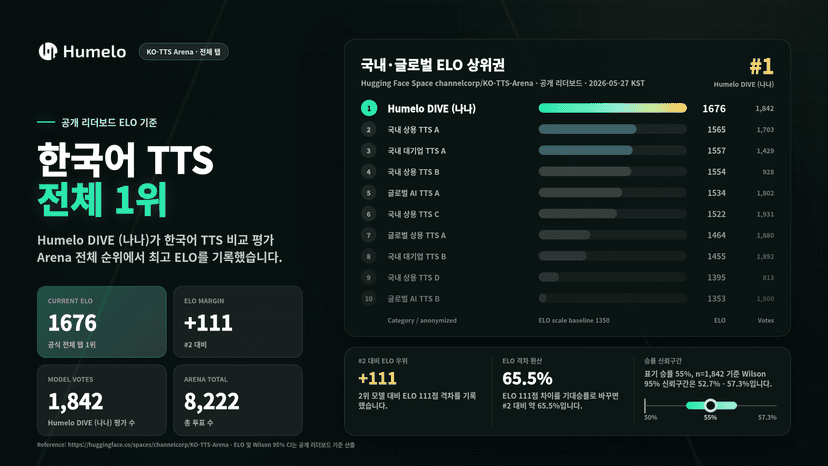

- 대표 연구: VALL-E (Microsoft), 휴멜로 DIVE

휴멜로 DIVE는 2초 음성만으로 30초 이내에 보이스클로닝을 완료합니다. Zero-shot 방식의 실용적 한계를 돌파한 사례입니다.

Few-shot 보이스클로닝

- 필요 음성: 30초~5분

- 학습 과정: 소량 데이터로 빠른 적응(adaptation)

- 특징: Zero-shot보다 높은 유사도. 대부분의 상용 서비스가 이 방식

- 대표 서비스: ElevenLabs, Supertone Play

Fine-tuning 기반 커스텀 보이스

- 필요 음성: 수 시간~수십 시간

- 학습 과정: 전용 모델 학습 (수 일~수 주)

- 특징: 가장 높은 유사도와 안정성. 비용과 시간이 큼

- 대표 서비스: Google Custom Voice, 대형 스튜디오 전용 솔루션

어떤 방식을 선택해야 하나?

| 상황 | 추천 방식 | 이유 |

|---|---|---|

| 빠른 프로토타입 | Zero-shot | 즉시 테스트 가능 |

| 브랜드 보이스 구축 | Zero-shot + 튜닝 | 속도와 품질의 균형 |

| 방송·광고급 품질 | Fine-tuning | 최고 유사도 필요 |

| 다수 화자 대응 | Zero-shot | 화자당 학습 비용 없음 |

3) 보이스클로닝은 어떤 원리로 작동하는가?

보이스클로닝의 기술적 파이프라인은 크게 4단계로 구성됩니다.

1단계: 화자 임베딩(Speaker Embedding) 추출

기준 음성(reference audio)을 Speaker Encoder에 입력하면, AI가 해당 화자의 음성 특징을 고차원 벡터(임베딩)로 압축합니다.

이 벡터에는 다음 정보가 담깁니다:

- 음색(밝은 목소리, 허스키한 목소리 등)

- 발화 패턴(빠르게 말하는 스타일, 차분한 스타일 등)

- 음역대 및 음향적 특성

핵심: 2초짜리 음성에서도 화자를 구분할 수 있을 만큼의 정보를 추출합니다.

2단계: 텍스트 분석(Text Frontend)

입력 텍스트를 "어떻게 읽을지" 결정하는 단계입니다.

- 텍스트 정규화: "25년" → "이십오년" 또는 "스물다섯년" (문맥에 따라)

- 형태소 분석 및 품사 처리: 한국어 조사·어미 처리

- Grapheme-to-Phoneme(G2P): 글자를 발음 기호로 변환

- 운율(Prosody) 예측: 끊어읽기, 강세, 억양 패턴 결정

한국어에서 이 단계가 특히 중요합니다. "데이터"를 "데이터"로 읽을지 "데이타"로 읽을지, "25일"을 "이십오일"로 읽을지 "스물다섯일"로 읽을지는 문맥이 결정합니다.

3단계: 음향 표현(Acoustic Representation) 생성

화자 임베딩과 텍스트 분석 결과를 결합하여, 중간 음향 표현을 만듭니다.

전통적 방식 (Tacotron 계열):

- 텍스트 + 화자 임베딩 → Mel Spectrogram 생성

최신 방식 (VALL-E 계열):

- TTS를 조건부 언어 모델링(conditional language modeling) 문제로 접근

- Mel Spectrogram 대신 Discrete Audio Codec 기반 표현을 예측

- 음색뿐 아니라 리듬·억양·강세까지 통합 모델링

4단계: 보코더(Vocoder)로 최종 음성 파형 생성

음향 표현(Mel Spectrogram 또는 Codec 토큰)을 실제 사람이 듣는 오디오 파형(waveform) 으로 변환합니다.

대표적 보코더:

- HiFi-GAN: 빠른 추론 속도 + 고품질

- WaveNet: 높은 음질, 느린 추론

- Encodec/SoundStream: 코덱 기반 디코딩

최종 음성의 "사람처럼 들리는 정도" 는 이 보코더의 품질에 크게 좌우됩니다.

실제 서비스에서의 추가 요소

연구실 데모와 실제 서비스의 차이를 만드는 것은 다음 요소들입니다:

| 요소 | 연구 데모 | 실제 서비스 |

|---|---|---|

| 지연시간 | 수 초 허용 | 0.3초 이하 필수 (대화형) |

| 오디오 포맷 | WAV 단일 | PCM, U-LAW, MP3 등 다양 |

| 배포 환경 | 클라우드 | 온프레미스·망분리 필요 |

| 문맥 제어 | 단일 문장 | 대화 흐름에 맞는 감정·속도 |

4) 보이스클로닝은 어디에 활용되는가?

AICC (AI 컨택센터) / 콜봇

- 기업 고유의 상담 음성을 AI로 복제하여 24시간 운영

- 기존 상담사 목소리로 자연스러운 AI 응대 구현

- 신한은행 사례: 일 4~8만 콜 중 25%를 AI가 자체 해결, 평균 대기시간 27초 → 6초

콘텐츠 제작 / 더빙

- 유튜브 내레이션: 크리에이터 본인 목소리로 대량 콘텐츠 자동 생성

- 다국어 더빙: 한국어 화자의 목소리로 영어·일본어 발화 (크로스링구얼)

- 오디오북: 저자 본인의 목소리로 수십 시간 분량 자동 녹음

브랜드 보이스 / 광고

- 기업 고유의 AI 목소리를 브랜드 자산으로 구축

- 광고 나레이션의 빠른 수정·다변화

- 시즌별/캠페인별 톤 변경 (같은 화자, 다른 감정)

접근성(Accessibility)

- 음성 장애인의 과거 목소리 복원

- 개인화된 보조 음성 생성

- 교육용 맞춤 음성 서비스

게임 / 엔터테인먼트

- NPC 음성 대량 생성 (수백 캐릭터 × 수천 대사)

- 고인 성우의 목소리로 신규 콘텐츠 제작 (유족 동의 하에)

- 팬 참여형 인터랙티브 콘텐츠

5) 주요 보이스클로닝 서비스 비교 (2026년)

| 기준 | 휴멜로 DIVE | ElevenLabs | Supertone Play | Typecast |

|---|---|---|---|---|

| 클로닝 소요 음성 | 2초 | 30초 | 10초 | 비즈니스 플랜 |

| 클로닝 완료 시간 | 30초 이내 | 즉시 | 수 분 | 수 분 |

| 한국어 MOS | 4.63 | — | — | — |

| 응답 지연 | 0.3초 이하 | 0.3~1초 | 1~2초 | 1~3초 |

| 스트리밍 | 실시간 | 지원 | 지원 | 미지원 |

| 최대 음질 | 48kHz | 44.1kHz | 44.1kHz | 48kHz |

| 온프레미스 | 지원 (망분리) | 미지원 | 별도 협의 | 미지원 |

| 크로스링구얼 | 한·영·일·중·스페인 | 70개+ 언어 | 23개 언어 | 한·영·일 |

| 데이터 리전 | 한국 (서울) | 미국/EU | — | — |

6) 보이스클로닝의 윤리와 법적 쟁점

보이스클로닝 기술이 발전할수록 악용 위험도 함께 커집니다.

주요 위험

- 보이스 피싱: 가족·지인 목소리를 복제해 금전 요구

- 딥페이크 음성: 공인의 발언을 조작해 여론 조작

- 무단 복제: 성우·연예인 목소리를 동의 없이 사용

글로벌 규제 동향 (2026년)

| 지역 | 규제 내용 |

|---|---|

| 미국 FCC | AI 생성 음성이 포함된 로보콜을 규제 범주로 명확화 |

| EU AI Act | AI 생성 콘텐츠의 표시·라벨링 의무 추진 |

| 한국 | 딥페이크 관련 정보통신망법 개정, 성우 음성권 논의 진행 중 |

기업이 지켜야 할 원칙

- 명시적 동의: 화자 본인의 서면 동의 필수

- 용도 제한: 동의받은 범위 내에서만 사용

- 데이터 관리: 음성 데이터의 보관 기간·폐기 절차 명확화

- 워터마킹: AI 생성 음성임을 식별할 수 있는 기술적 장치

- 감사 추적: 누가, 언제, 어떤 목적으로 사용했는지 기록

7) 기업이 보이스클로닝을 도입할 때 체크리스트

체크 1: 동의와 저작권

- 화자의 명시적 서면 동의를 받았는가?

- 사용 범위(기간, 용도, 지역)가 계약에 명시되어 있는가?

- 음성 데이터의 보관·폐기 절차가 정해져 있는가?

체크 2: 한국어 품질

- 조사·어미·끊어읽기가 자연스러운가?

- 숫자·단위·전문용어를 문맥에 맞게 읽는가?

- 구어체/대화체에서도 자연스러운가?

- MOS 점수 또는 동급 객관적 평가 지표가 있는가?

체크 3: 기술 요구사항

- 서비스에 필요한 지연시간(레이턴시)을 충족하는가?

- 필요한 오디오 포맷(WAV, MP3, PCM, U-LAW)을 지원하는가?

- 실시간 스트리밍이 필요한 경우 지원되는가?

- API 연동이 용이한가? SDK가 제공되는가?

체크 4: 보안 및 배포

- 데이터가 한국 리전에서 처리되는가?

- 온프레미스 배포가 필요한 경우 지원되는가?

- 망분리 환경에서도 동작하는가?

- SOC2, ISO 27001 등 보안 인증이 있는가?

체크 5: 확장성

- 동시 요청 처리 능력은 충분한가?

- 다국어 확장이 필요할 때 대응 가능한가?

- 보이스 에이전트, AICC 등으로의 확장 경로가 있는가?

결론

보이스클로닝은 "닮은 목소리를 만드는 기술" 을 넘어, "특정 화자의 정체성을 디지털로 확장하는 기술" 로 진화하고 있습니다.

2026년 현재:

- 2초 음성으로 즉시 복제 가 가능하고

- 0.3초 이하 지연으로 실시간 대화에 투입할 수 있으며

- 한국어 운율까지 자연스럽게 처리하는 수준에 도달했습니다

기업이 보이스클로닝을 도입할 때 가장 중요한 것은 "음질 데모에 속지 않는 것" 입니다. 실제 서비스 환경에서의 지연시간, 한국어 문맥 처리, 배포 유연성, 저작권 관리까지 — 이 모든 것이 갖춰져야 신뢰할 수 있는 AI 음성 경험이 완성됩니다.

FAQ

Q. 보이스클로닝이란 무엇인가요?

보이스클로닝(Voice Cloning)은 특정 사람의 음색, 억양, 말투 등 음성 특징을 AI가 학습하여, 그 사람이 직접 말하지 않은 새로운 문장을 해당 화자의 목소리로 합성하는 기술입니다. 2초~30초의 짧은 음성 샘플만으로도 복제가 가능합니다.

Q. 보이스클로닝과 TTS의 차이는 무엇인가요?

TTS(Text-to-Speech)는 텍스트를 음성으로 변환하는 넓은 범주의 기술이고, 보이스클로닝은 그중에서도 특정 화자의 목소리 특징을 유지하여 새로운 문장을 생성하는 기술입니다. 일반 TTS는 미리 학습된 AI 음성을 사용하지만, 보이스클로닝은 원하는 사람의 목소리를 복제합니다.

Q. 보이스클로닝에 필요한 최소 음성 데이터는 얼마인가요?

기술 방식에 따라 다릅니다. Zero-shot 방식은 2~10초, Few-shot 방식은 30초~5분, Fine-tuning 방식은 수 시간이 필요합니다. 휴멜로 DIVE는 Zero-shot 방식으로 2초 음성만으로 30초 이내에 클로닝을 완료합니다.

Q. 보이스클로닝은 합법인가요?

보이스클로닝 기술 자체는 합법이지만, 사용 방식에 따라 법적 문제가 발생할 수 있습니다. 화자의 명시적 동의 없이 목소리를 복제·사용하면 초상권·음성권 침해가 될 수 있으며, 사칭 목적의 사용은 형사 처벌 대상입니다. 기업 도입 시에는 반드시 화자 동의와 사용 범위를 계약으로 명확히 해야 합니다.

Q. 음성 샘플이 길수록 보이스클로닝 품질이 좋아지나요?

반드시 그렇지는 않습니다. 보이스클로닝 품질은 샘플 길이보다 녹음 품질, 발화 다양성, 도메인 적합성에 더 큰 영향을 받습니다. 잡음이 많은 10분 녹음보다 깨끗한 환경에서 녹음한 2초가 더 좋은 결과를 낼 수 있습니다.

Q. 한국어 보이스클로닝에서 가장 어려운 점은 무엇인가요?

한국어는 발음보다 운율(프로소디) 이 더 어렵습니다. 조사("을/를", "이/가"), 어미("-합니다" vs "-해요"), 끊어읽기, 숫자·단위 읽기 등에서 미세한 차이가 자연스러움을 결정합니다. 글로벌 서비스가 "한국어 지원"을 표기하더라도, 이러한 운율 처리에서 차이가 나는 경우가 많습니다.

Q. 실시간 대화에 보이스클로닝을 사용할 수 있나요?

가능합니다. 단, 응답 지연시간(레이턴시) 이 핵심입니다. 자연스러운 대화 경험을 위해서는 첫 음성까지 0.3초 이내가 권장됩니다. 휴멜로 DIVE는 실시간 스트리밍 방식으로 0.3초 이하 지연을 달성하여, AICC·콜봇·보이스 에이전트에서의 실시간 대화에 적합합니다.

Q. 보이스클로닝으로 다른 언어도 말할 수 있나요?

크로스링구얼(Cross-lingual) 보이스클로닝을 지원하는 서비스에서는 가능합니다. 예를 들어, 한국어 화자의 목소리로 영어나 일본어 문장을 발화할 수 있습니다. 휴멜로 DIVE는 한국어, 영어, 일본어, 중국어, 스페인어의 크로스링구얼을 지원합니다.

Q. 기업이 보이스클로닝을 도입할 때 가장 중요한 것은 무엇인가요?

음질 외에 다음 5가지를 함께 검토해야 합니다: (1) 화자 동의 및 저작권 확보, (2) 한국어 운율 품질 검증, (3) 서비스 요구 지연시간 충족 여부, (4) 오디오 포맷 및 배포 방식 적합성, (5) 보안 및 데이터 주권 요건. 특히 금융·공공 분야에서는 온프레미스 배포와 한국 리전 데이터 처리가 필수 조건이 됩니다.

보이스클로닝 도입을 검토 중이신가요?

휴멜로는 2초 보이스클로닝 DIVE, 실시간 TTS FRTTS, 망분리 On-Premise까지 기업 환경에 맞는 최적의 구성을 제안합니다.

📞 도입 문의: 여기를 클릭하세요